Protección De La Privacidad Y Seguridad De Datos

Nuestra Labor /

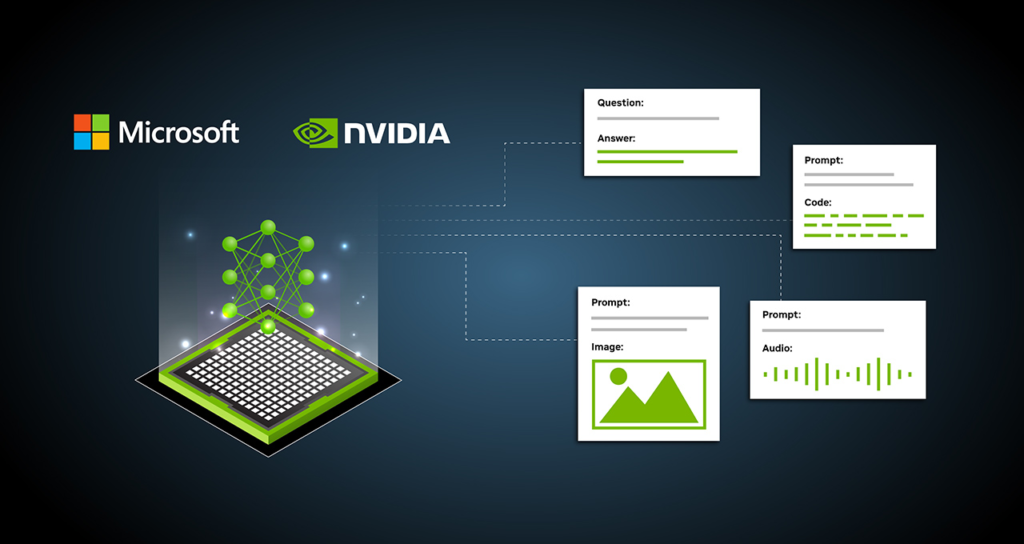

Dada la posibilidad de mal uso de la inteligencia artificial, ¿cómo desarrollamos y desplegamos sistemas algorítmicos de manera responsable?

Prever riesgos futuros

Desarrollar mejores prácticas

Mejorar la preparación

Establecer bases de gobierno

Cada vez más, los sistemas de IA se implementan en contextos donde los riesgos de seguridad pueden tener consecuencias generalizadas, incluyendo medicina, finanzas, transporte y redes sociales. Esto hace que anticipar y mitigar tales riesgos, tanto a corto como a largo plazo, sea una necesidad urgente para la sociedad.

Nuestro Programa de IA Crítica para la Seguridad reúne a socios y otros interesados para desarrollar mejores prácticas que puedan ayudarnos a prevenir accidentes probables, usos indebidos y consecuencias no deseadas de las tecnologías de IA. No es necesario esperar a que ocurran incidentes de este tipo. Como muestra nuestro trabajo, se pueden tomar precauciones tan temprano como en la etapa de investigación para garantizar el desarrollo de sistemas de IA seguros.

Nuestro Trabajo en IA Crítica para la Seguridad

El Programa de IA Crítica para la Seguridad ha desarrollado normas para la publicación responsable de investigaciones en IA, respaldado el lanzamiento de la Base de Datos de Incidentes de IA y creado SafeLife, un novedoso entorno de aprendizaje de IA para entrenar agentes no destructivos.

Participa

Para recibir actualizaciones sobre este programa, incluyendo correos electrónicos trimestrales de actualización, subscríbete aquí.

Novedades